Le Théorème de Bayes : La Formule Secrète au Cœur de l'Intelligence Artificielle

Sommaire de l'article

Si vous deviez ouvrir le capot des intelligences artificielles les plus modernes, des logiciels capables de trier des millions d’emails jusqu’aux cerveaux des voitures autonomes, vous y trouveriez un vieux bout de papier jauni datant de 1763.

Dessus, une équation écrite par un pasteur britannique nommé Thomas Bayes.

Cette formule, le Théorème de Bayes, est l’un des concepts mathématiques les plus puissants jamais découverts. C’est l’outil ultime pour calculer l’incertitude et prendre des décisions logiques quand il nous manque des informations. Autrement dit, c’est le manuel d’instructions de base pour apprendre à une machine à “réfléchir”.

En bref : Le théorème de Bayes est une méthode mathématique permettant de mettre à jour ses croyances (probabilités) à mesure que l’on obtient de nouvelles preuves. Dans le Machine Learning, il sert de fondation probabiliste pour aider l’IA à prendre des décisions — par exemple pour décider si un email est un “spam” ou pour aider un diagnostic médical face à des symptômes ambigus.

Mettez les mathématiques de côté un instant. Imaginez que vous venez de vous réveiller. Les volets de votre chambre sont fermés.

Si je vous demande : “Quelle est la probabilité qu’il pleuve ce matin ?”, vous regardez la météo, vous regardez la saison : c’est l’été dans le Sud de la France. Vous répondez spontanément : “Il y a 10 % de chances qu’il pleuve.” C’est ce qu’on appelle votre croyance a priori (la probabilité de base).

Maintenant, vous ouvrez les volets. Vous voyez que le poteau électrique devant chez vous est trempé. Le poteau mouillé est la nouvelle information.

Votre cerveau va instantanément réévaluer la probabilité qu’il pleuve. Bien sûr, le poteau a pu être arrosé par la ville, ou par un enfant avec un pistolet à eau. Mais la vraisemblance que le poteau soit mouillé parce qu’il pleut l’emporte. Sans faire de calculs compliqués, votre cerveau revoit sa prédiction : “Vu que le poteau est mouillé, il y a maintenant 90 % de chances qu’il pleuve.”

C’est ça, le Théorème de Bayes. C’est la mécanique mathématique du “changement d’avis” rationnel quand on découvre un nouvel indice.

La formule expliquée (Sans migraine)

Pour les amateurs de chiffres, voici l’équation. Mais vous allez voir, elle décrit simplement l’exemple ci-dessus.

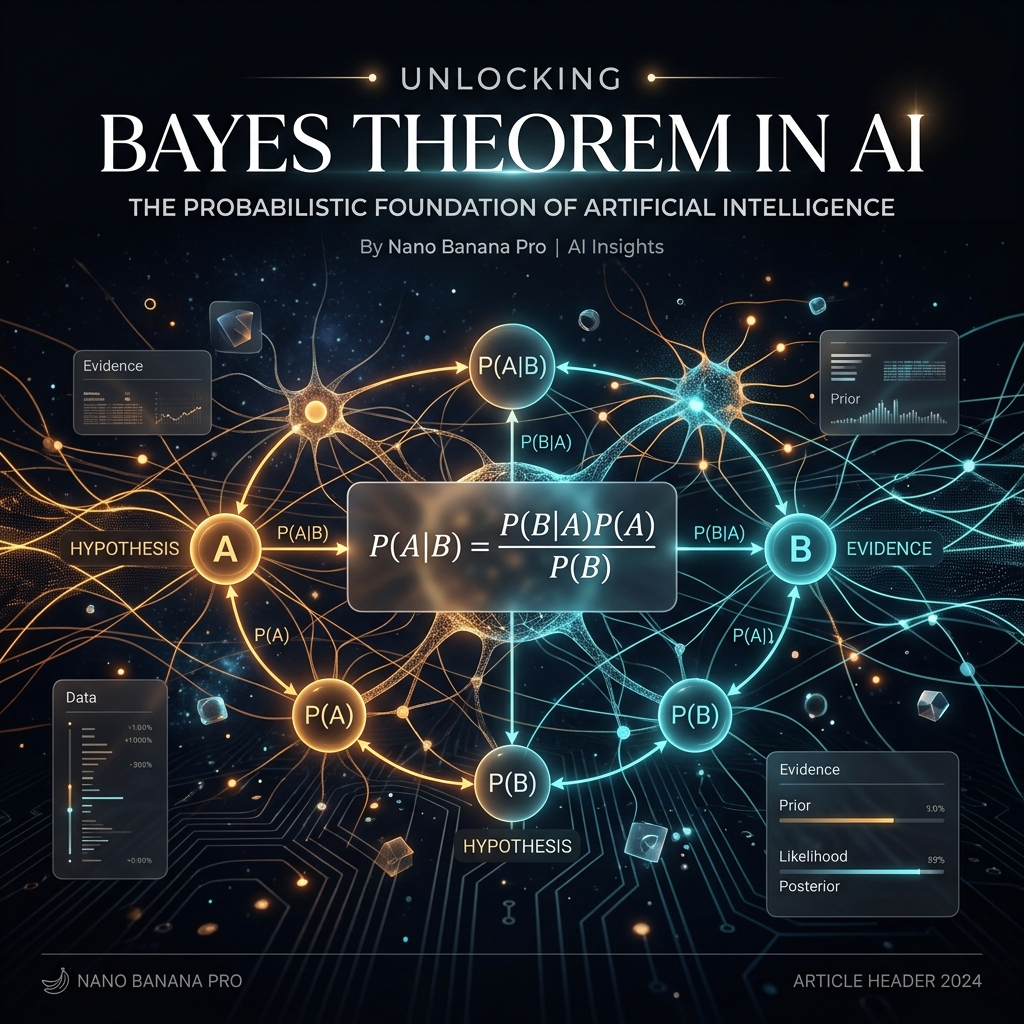

$$ P(A|B) = \frac{P(B|A) \times P(A)}{P(B)} $$

- P(A|B) : “Probabilité A posteriori”. Quelle est la chance que l’Hypothèse (A : Il pleut) soit vraie sachant que l’Indice (B : Poteau mouillé) est là ? C’est ce que l’IA cherche à calculer.

- P(A) : “Croyance A priori”. C’était la probabilité qu’il pleuve (10 %) avant même de regarder le poteau.

- P(B|A) : “La Vraisemblance”. Si de toute façon il pleuvait à torrents, quelle était la chance que le poteau soit effectivement mouillé ? Très forte.

- P(B) : La chance de voir un poteau mouillé dans l’absolu (qu’il pleuve, où qu’un chien ait fait dessus, ou qu’il ait été lavé).

Le piège du médecin : Pourquoi Bayes est vital

L’un des cas d’usage où Bayes brille (et où notre propre cerveau a souvent tout faux), c’est le diagnostic médical.

Imaginez un test de dépistage d’une maladie très rare (elle touche 1 personne sur 10 000). Ce test médical est qualifié d’excellent : il a une fiabilité de 99 %. Vous passez le test. Il revient POSITIF.

Poussé par la panique, vous pensez avoir 99 % de chances d’être malade (vu la fiabilité du test). L’être humain est très mauvais en statistiques.

Mais si on donne le problème au Théorème de Bayes :

- La maladie est si rare (la croyance a priori P(A) est minuscule).

- Sur 10 000 personnes, 1 est malade (testée positive avec raison).

- Mais 9 999 sont en bonne santé. Avec un test à 99% de fiabilité (donc 1% de faux positifs), le test va déclarer à tort que 100 de ces personnes sont malades.

- Au total, 101 personnes auront un test positif. Or, une seule d’entre elles est réellement malade.

Si l’ordinateur de l’hôpital utilise le théorème de Bayes, il vous annoncera que malgré un test très fiable, votre test positif ne signifie qu’il n’y a qu’en fait que ~1 % de chances que vous soyez malade. La probabilité a été renversée grâce au savoir médical mathématisé.

L’impact de Bayes sur le Machine Learning : Les filtres Spams

C’est là que le rapport avec l’Intelligence Artificielle moderne devient passionnant. Dans les années 2000, le monde a failli être englouti sous les emails non-désirés (spam). Ce qui nous a sauvés, c’est ce qu’on appelle un Classificateur Naïf de Bayes (Naive Bayes Classifier).

C’est un modèle de Machine Learning extrêmement connu, rapide et redoutable.

Pour lui, un email reçu contenant les mots :“Viagra”, “Gagner de l’argent” et “Gratuit” correspond aux différents poteaux mouillés de l’exemple précédent (les indices $B_1$, $B_2$, $B_3$).

- L’IA sait d’expérience qu’une boîte mail normale contient environ 30% de SPAM (P(A)).

- L’IA a “lu” l’historique de vos spams passés et a calculé la récurrence de chaque mot.

- Quand l’email arrive, elle combine les probabilités : Sachant que l’émetteur a utilisé le mot “Gagner de l’argent” (qui apparaît dans 80% des spams mais seulement 1% des vrais emails), la probabilité bascule.

Dès que le score bayésien dépasse les 99 %, l’IA envoie catégoriquement le mail dans les indésirables, en une fraction de milliseconde. On l’appelle classificateur “Naïf” parce qu’il postule, pour calculer plus vite, que tous les mots (les variables) sont indépendants les uns des autres.

Pourquoi le raisonnement bayésien est toujours d’actualité en 2026 face à DeepMind / OpenAI

Depuis 2023, le “Deep Learning” (Gros réseaux de neurones / ChatGPT / Gemini) monopolise l’attention. On pourrait croire que la vieille formule du 18ème siècle a été mise au placard. C’est faux.

1. L’avantage de l’Incertitude

La grande faiblesse des réseaux de neurones (Deep Learning), c’est qu’ils sont “trop sûrs d’eux”. Si l’IA Deep Learning hallucine, elle vous sortira une bêtise absolue avec la confiance du dictionnaire Larousse.

L’approche Bayésienne est humble par nature. Une Infèrence Bayésienne retourne un niveau d’incertitude qualifié. C’est pour cela que les algorithmes pilotant les avions ou les voitures autonomes combinent les réseaux de neurones à des couches probabilistes bayésiennes : quand un capteur de voiture voit une tache pixélisée, la couche bayésienne dit “Il y a 60 % de chance que ce soit un nuage, 40 % un platane : freine”.

2. Le besoin de peu de données

Un grand modèle de langage LLM de 2026 (comme GPT-4 ou Claude 3.5) a dû ingérer des milliards de lignes de textes pendant des mois pour “comprendre” des concepts basiques.

Les modèles Bayes, eux, sont capables d’apprendre très vite sur de très petites quantités de données (quelques milliers d’exemples suffisent parfois), tout en restant mathématiquement compréhensibles de A à Z (contrairement au Deep Learning, qui conserve le problème de la “boîte noire”).

FAQ — Questions fréquentes sur Bayes et l’IA

C’est quoi la probabilité bayésienne simplement ?

C’est une théorie où les probabilités mathématiques ne sont pas considérées comme des vérités absolues figées (comme le fait de lancer un dé indéfiniment), mais comme des “niveaux de croyance” qui doivent obligatoirement être mis à jour à chaque fois que l’on reçoit une nouvelle donnée probante. On part d’un a priori, on observe, puis on consolide (probabilité a posteriori).

À quoi sert le Naive Bayes en Intelligence Artificielle ?

L’algorithme Naive Bayes est l’une des stars historiques de la classification en machine learning. Il sert essentiellement à classer du texte très vite : comme décider si un Tweet est un sentiment positif ou négatif, ou décider de filtrer un email dans la boîte “Courrier Indésirable” ou “Prioritaire”.

Pourquoi l’algorithme s’appelle-t-il “Naïf” ?

Le modèle est dit empiriquement “naïf” car il repose sur une pure utopie mathématique : l’hypothèse (pour simplifier ses calculs) que toutes les caractéristiques d’une situation sont complètement indépendantes les unes des autres. Dans le cas d’un email, il considère naïvement que la présence du mot “Casino” n’influence pas la présence du mot “Roulette”.

Y a-t-il un lien entre Thomas Bayes et Alan Turing ?

Éloigné géographiquement, mais étroit dans la science. Le célèbre mathématicien Alan Turing, inventeur du Test de Turing et destructeur de la fameuse machine Enigma pendant la seconde guerre mondiale, a massivement utilisé les probabilités bayésiennes au sein de la “Bombe” (sa machine de décryptage) pour casser le code allemand bien plus vite que l’approche “Brute force”.

Le Deep Learning a-t-il tué l’approche bayésienne ?

Non, il y a même une discipline majeure qui s’appelle le “Bayesian Deep Learning”. Les ingénieurs du Machine Learning intègrent aujourd’hui le théorème de Bayes au sein de réseaux pour estimer le risque d’incertitude dans les prévisions des intelligences artificielles (“Le réseau pense-t-il vraiment ça, ou bien hallucine-t-il parce que les données étaient polluées ?”).

Ce qu’il faut retenir

Il est fascinant de constater que les percées technologiques les plus pointues des algorithmes à Wall Street, des flottes Uber, et de la génomique moléculaire moderne (découverte de médicaments assistés par IA) n’auraient pas été rendues mathématiquement possibles sans les brouillons publiés par le révérend presbytérien Richard Price… au nom de son ami défunt Thomas Bayes, dans une Angleterre sans internet il y a 250 ans.

Le monde des algorithmes modernes est un triomphe de la technologie de calcul, mais ce sont bien des équations ancestrales qui lui soufflent comment réfléchir.